что-то на DL-ском

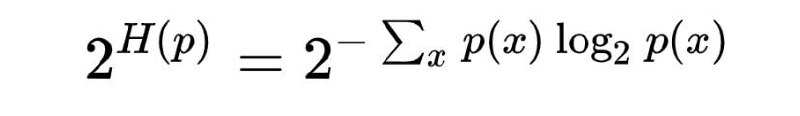

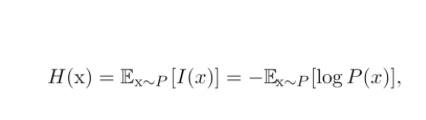

Докажем, определения и выводы на основе формул. Где p – распределение вероятностей, которое мы хотим...

Читать далее

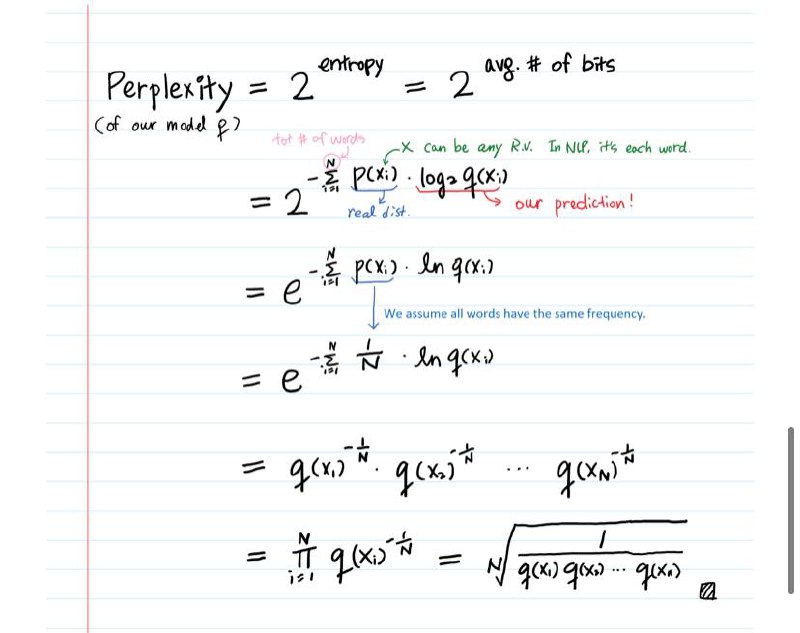

perplexityЕсли описать простоты языком, perplexity (недоумение) – насколько хорошо модель предсказыв...

Читать далееПРОДОЛЖЕНИЕЧто насчёт того случая, когда мы имеем не равновероятные события? Опишем пример. Имеем 4...

Читать далее

Энтропия ШеннонаВид энтропии из которого вытекает функция потерь под названием Кросс-энтропия (https...

Читать далееhttps://ai.googleblog.com/2020/01/towards-conversational-agent-that-can.html?m=1MeenaДиалоговая моде...

Читать далееhttps://jalammar.github.io/illustrated-gpt2/ Опишем, как происходит процесс генерации текста в 💮GP...

Читать далееhttps://jalammar.github.io/illustrated-gpt2/Опишем, как происходит процесс генерации текста в 💮GPT-...

Читать далеемоделирование языка вычисляется так: проецируем скрытое состояние на матрицу встраивания слов, чтобы...

Читать далее