— Открываем терминал, и делаем «

git clone https://github.com/ggerganov/llama.cpp.git» в нужную папку;— Заходим в папку и делаем «

LLAMA_METAL=1 make -j»;— Ждем прогрузки;

— Запускаем веб сервер этой командой «

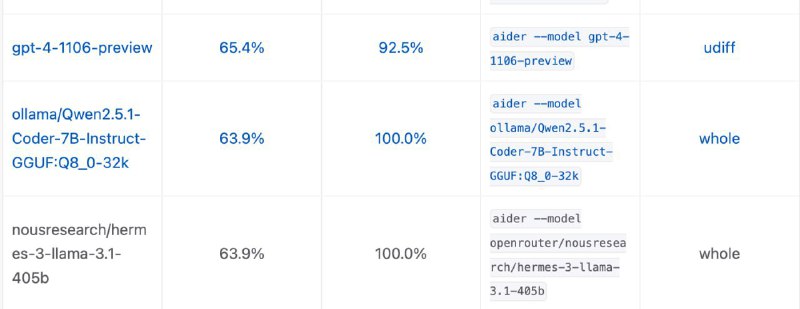

./llama-server -m «./models/Qwen2.5.1-Coder-7B-Instruct-Q5_K_M.gguf» -t 8 —mlock -v —alias totally-not-an-AGI -fa —temp 0.4 —repeat-penalty 1.10 —repeat-last-n −1 —top-k 40 —top-p 0.90 —min-p 0.10 -c 16000». Что означает каждый параметр можно почитать тут;— Открываем в браузере http://127.0.0.1:8080/

● Следи за новостями - VA-PC CODE

● Наш основной канал