мультимодальная модель способная анализировать изображения и получать текстовые файлы на вход, поддерживает десятки языков и управление длинными контекстами — с высокой скоростью и очень низким потреблением ресурсов для такого уровня модели.

🛠 Mistral Small 3.1 24B — это модель с открытым исходным кодом, выпущенная 18 марта 2025 года следом за Gemma 3. Модель доступна в размерах 24 млрд. параметров (24B). Это прямой конкурент вышедшей чуть ранее Gemma 3 и очень близка по возможностям, но по скорости опережает Gemma 3. В Gemma 3 27 млрд. параметров, а Mistral Small 3.1 24 млрд. параметров, соответственно модель меньше и меньше ресурсов требует.

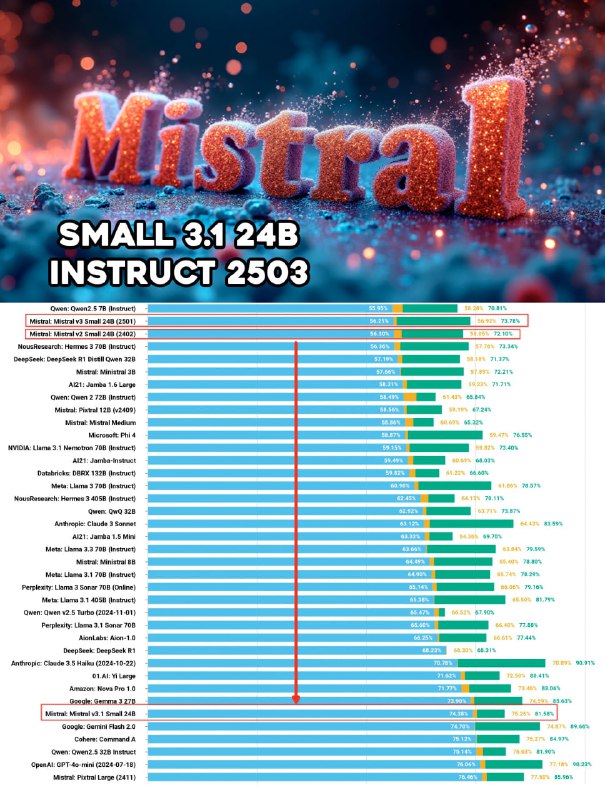

📈 На изображении выше сравнение Mistral Small 3.1 24B с другими моделями и со своей предыдущей версией. Только посмотрите какой скачок она сделала. Полный график приложу в комментариях к посту.

Окно контекста в 128 000 токенов.

🌳 Mistral Small 3.1 очень быстрая модель, она уже доступна в LMStudio и на RTX 4090 выдаёт - 47 tok/sec

Для стравнения Gemma 3 - 11 tok/sec.

📚 Мультимодальность Mistral Small 3.1

Модель способна анализировать изображения и текстовые файлы.

Как попробовать эту модель:

Обновить lmstudio.

В поиске пишете: Mistral-Small-3.1

Точность выбирайте под свой объем видеопамяти, для 24Gb Q4_1 влезает полностью. Весит 15Гб.

Автор конвертации: mrfakename

Полное название: mistral-small-3.1-24b-instruct-2503-gguf

Если модель полностью не влезит в VRAM то будет работать медленнее, но скорее всего тоже быстро.

📌 Страница разработчика: ССЫЛКА

НАШИ РЕСУРСЫ

telegramСhat, Youtube, Rutube, курсы stabledif.ru