Последний пост по поводу Reflection, я больше писать про это не буду, честно-честно. Если кто-то по этому посту захочет сделать ролик на ютубе, я разрешаю.

Для начала обобщим таймлайн:

5 сентября

1) Твит создателя, якобы лучшая открытая модель, метрики от разработчиков, GSM8K 99.2% (при том, что там неправильных примеров может быть больше 1%). Модель сломана, неправильно залиты embed_tokens и lm_head, и из-за этого она не выдаёт спецтокены типа <thinking>. Никаких разумных замеров из-за этого сделать в принципе нельзя. Но зато работает сайт с моделью.

6 сентября

2) Сайт с моделью перестал работать из-за нагрузки. Больше он не поднимется.

3) Meta попросила добавить Llama 3.1 в название по условиям лицензии.

4) Первый "независимый" бенчмарк: модель выше 405B. Неясно, делалось ли это через API, или через всё ещё сломанную модель на HF.

5) Модель чинят перезаливом по одному файлику (!), в процессе перезалива она внезапно становится тюном Llama 3, а не Llama 3.1. Позже это подтвердят. Как так вышло автор не знает. Там же он показывает, что не знает, что такое LoRA. Модель действительно теперь выдаёт спецтокены, но даже на отдельных примерах качество ниже заявленного.

7 сентября

6) День рождения девушки автора, что автор использует в качестве оправдания.

7) Автор заявляет, что починенная модель это на самом деле не та самая модель, и что он это исправит в течение дня.

8) Починенную модель прогнали на другом независимом бенче, получилось хуже оригинальной 70B.

8 сентября

9) Следующая версия модели оказалось всё ещё не той самой, и теперь модель нужно переобучить заново, что странно само по себе.

10) Ребята из пункта 8 замерили метрики через авторское API, получили уровень Соннета. Сейчас их твит удалён.

9 сентября <- мы находимся здесь

11) Вышла новая версия модели, и по предварительным оценкам ребят из пункта 8, всё ещё очень плохо.

12) API выложили на OpenRouter.

13) API оказался проксей для Соннета. Чуть позже Соннет заменили на gpt-4o, а потом на Llama 3.1 70B.

Я намеренно упустил ветку с Glaive и инвестированием. Цели пока тоже бессмысленно обсуждать.

Неправильные ходы:

1) Ни в коем случае не надо было сразу выкладывать какую-либо модель. Как минимум неделю можно было так выиграть.

2) Надо было меньше отвечать. Лучше быть загадочным, чем технически неграмотным.

3) Ни в коем случае нельзя было давать API широкой публике. Ход с OpenRouter — полный провал.

Хорошие ходы:

1) Выложить модель в float32, чтобы затруднить скачивание.

2) Выложить сначала поломанную модель, чтобы тоже выиграть время.

3) Постоянно обновлять модель, чтобы всегда можно было сказать "вы не то оценивали" (каюсь, сам грешен по этому пункту).

4) Ретвитить только положительные отзывы, создавать у своих подписчиков иллюзию того, что всё прекрасно.

5) Использовать традиционные СМИ для пиара.

Для начала обобщим таймлайн:

5 сентября

1) Твит создателя, якобы лучшая открытая модель, метрики от разработчиков, GSM8K 99.2% (при том, что там неправильных примеров может быть больше 1%). Модель сломана, неправильно залиты embed_tokens и lm_head, и из-за этого она не выдаёт спецтокены типа <thinking>. Никаких разумных замеров из-за этого сделать в принципе нельзя. Но зато работает сайт с моделью.

6 сентября

2) Сайт с моделью перестал работать из-за нагрузки. Больше он не поднимется.

3) Meta попросила добавить Llama 3.1 в название по условиям лицензии.

4) Первый "независимый" бенчмарк: модель выше 405B. Неясно, делалось ли это через API, или через всё ещё сломанную модель на HF.

5) Модель чинят перезаливом по одному файлику (!), в процессе перезалива она внезапно становится тюном Llama 3, а не Llama 3.1. Позже это подтвердят. Как так вышло автор не знает. Там же он показывает, что не знает, что такое LoRA. Модель действительно теперь выдаёт спецтокены, но даже на отдельных примерах качество ниже заявленного.

7 сентября

6) День рождения девушки автора, что автор использует в качестве оправдания.

7) Автор заявляет, что починенная модель это на самом деле не та самая модель, и что он это исправит в течение дня.

8) Починенную модель прогнали на другом независимом бенче, получилось хуже оригинальной 70B.

8 сентября

9) Следующая версия модели оказалось всё ещё не той самой, и теперь модель нужно переобучить заново, что странно само по себе.

10) Ребята из пункта 8 замерили метрики через авторское API, получили уровень Соннета. Сейчас их твит удалён.

9 сентября <- мы находимся здесь

11) Вышла новая версия модели, и по предварительным оценкам ребят из пункта 8, всё ещё очень плохо.

12) API выложили на OpenRouter.

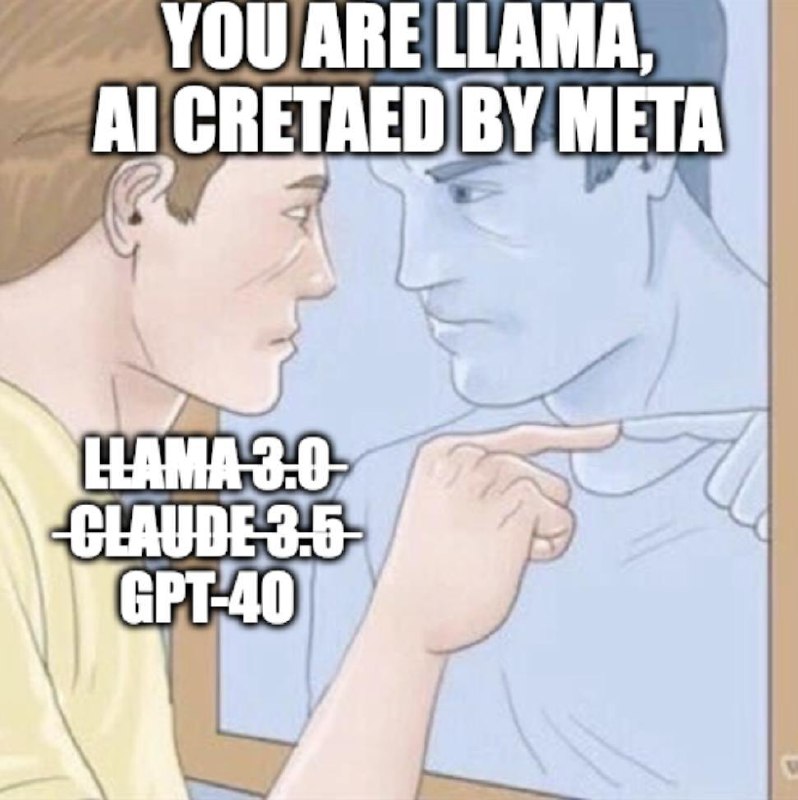

13) API оказался проксей для Соннета. Чуть позже Соннет заменили на gpt-4o, а потом на Llama 3.1 70B.

Я намеренно упустил ветку с Glaive и инвестированием. Цели пока тоже бессмысленно обсуждать.

Неправильные ходы:

1) Ни в коем случае не надо было сразу выкладывать какую-либо модель. Как минимум неделю можно было так выиграть.

2) Надо было меньше отвечать. Лучше быть загадочным, чем технически неграмотным.

3) Ни в коем случае нельзя было давать API широкой публике. Ход с OpenRouter — полный провал.

Хорошие ходы:

1) Выложить модель в float32, чтобы затруднить скачивание.

2) Выложить сначала поломанную модель, чтобы тоже выиграть время.

3) Постоянно обновлять модель, чтобы всегда можно было сказать "вы не то оценивали" (каюсь, сам грешен по этому пункту).

4) Ретвитить только положительные отзывы, создавать у своих подписчиков иллюзию того, что всё прекрасно.

5) Использовать традиционные СМИ для пиара.