А вообще - про нейминг вот. У GPT2/3 токенайзер зовется

Что такое🤔 Про кластеризацию много говорится в статье по последней ссылке

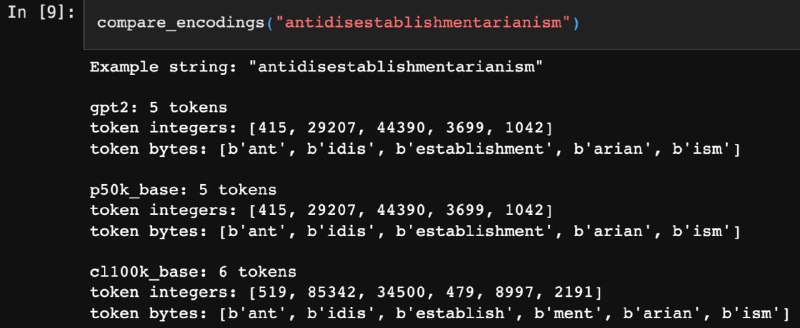

И на скринах два примера токенизации. В первом случае слово establishment не входит в словарь (видимо, кол-во английских слов в нём уменьшили), поэтому токенов выходит больше. На втором изображении видно, что японский (или какой это?) занимает теперь на целых ПЯТЬ токенов меньше.

Поиграться можно в этом ноутбуке.

r50k_base. У моделей, обученных на коде, и моделей 3.5 (их наследников) токенайзер p50k_base. У эмбеддера cl100k_base Что такое

k / p/ cl? Может ли cl значить CLustering? И на скринах два примера токенизации. В первом случае слово establishment не входит в словарь (видимо, кол-во английских слов в нём уменьшили), поэтому токенов выходит больше. На втором изображении видно, что японский (или какой это?) занимает теперь на целых ПЯТЬ токенов меньше.

Поиграться можно в этом ноутбуке.