Как оказывается, Дед Andrej, выйдя на работу в OpenAI, не бросил нас и продолжает накидывать образовательные интересные материалы.

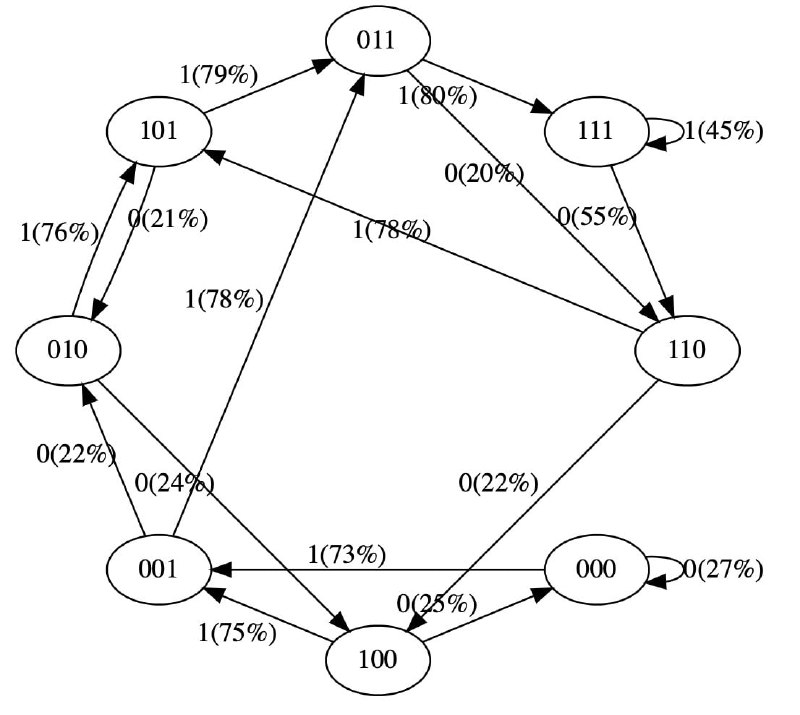

На этот раз он поделился colab'ом, где обучает трансформер с двумя токенами (нуль и единица) на одной конкретной последовательности, а затем смотрит, как выученные зависимости переносятся на увиденный моделью пример. Предположу, что делается это как проба пера для того, чтобы понимать принципы обучения более тяжелых моделей (как зависимости выстроены в них, какие вероятности переходов):

— Думаю, что интересно тренировать / изучать крошечные GPT, потому что становится легче визуализировать и получить интуитивное представление о всей системе.

Особенно интересно посмотреть, что модель делает с последовательностью из трёх нулей, которой не видела ранее. Какое будет предсказание? Как модель себя поведет на том куске "знаний", которые не получала напрямую?

Твит

Колаб

Ставь лайк, если хочешь тренировать игрушечные модели и получать за это 300кк/сек

На этот раз он поделился colab'ом, где обучает трансформер с двумя токенами (нуль и единица) на одной конкретной последовательности, а затем смотрит, как выученные зависимости переносятся на увиденный моделью пример. Предположу, что делается это как проба пера для того, чтобы понимать принципы обучения более тяжелых моделей (как зависимости выстроены в них, какие вероятности переходов):

— Думаю, что интересно тренировать / изучать крошечные GPT, потому что становится легче визуализировать и получить интуитивное представление о всей системе.

Особенно интересно посмотреть, что модель делает с последовательностью из трёх нулей, которой не видела ранее. Какое будет предсказание? Как модель себя поведет на том куске "знаний", которые не получала напрямую?

Твит

Колаб

Ставь лайк, если хочешь тренировать игрушечные модели и получать за это 300кк/сек