Как злоупотребляют генеративным ИИ?

Чаще всего — для создания дипфейков, а не для сложных атак.

К такому выводу пришла группа авторов из Google (включая DeepMind, Jigsaw). В статье Generative AI Misuse: A Taxonomy of Tactics and Insights from Real-World Data (PDF, пересказ) они предложили таксономию злоупотребления генеративным искусственным интеллектом, а также проанализировали около 200 публично известных инцидентов с января 2023 по март 2024.

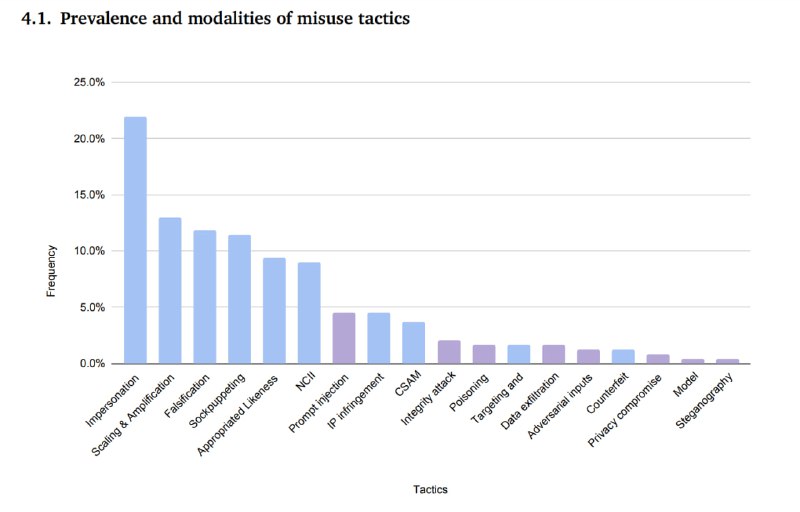

Авторы делят злоупотребление GenAI на две группы: эксплуатация возможностей GenAI (другими словами злоупотребление тем, что сгенерировано с помощью ИИ) и компрометация систем GenAI (т.е. различные атаки на сами системы: prompt injection, джейлбрейки и пр.).

В почти 90% изученных инцидентов использовались тактики из первой группы. По количеству на первом месте идут дипфейки — использование образа другого, часто известного человека (чаще всего генерируется аудио или видео, а не картинка).

Авторы оговариваются, что анализ ограничен инцидентами, освещавшимися в СМИ.

Чаще всего — для создания дипфейков, а не для сложных атак.

К такому выводу пришла группа авторов из Google (включая DeepMind, Jigsaw). В статье Generative AI Misuse: A Taxonomy of Tactics and Insights from Real-World Data (PDF, пересказ) они предложили таксономию злоупотребления генеративным искусственным интеллектом, а также проанализировали около 200 публично известных инцидентов с января 2023 по март 2024.

Авторы делят злоупотребление GenAI на две группы: эксплуатация возможностей GenAI (другими словами злоупотребление тем, что сгенерировано с помощью ИИ) и компрометация систем GenAI (т.е. различные атаки на сами системы: prompt injection, джейлбрейки и пр.).

В почти 90% изученных инцидентов использовались тактики из первой группы. По количеству на первом месте идут дипфейки — использование образа другого, часто известного человека (чаще всего генерируется аудио или видео, а не картинка).

Авторы оговариваются, что анализ ограничен инцидентами, освещавшимися в СМИ.