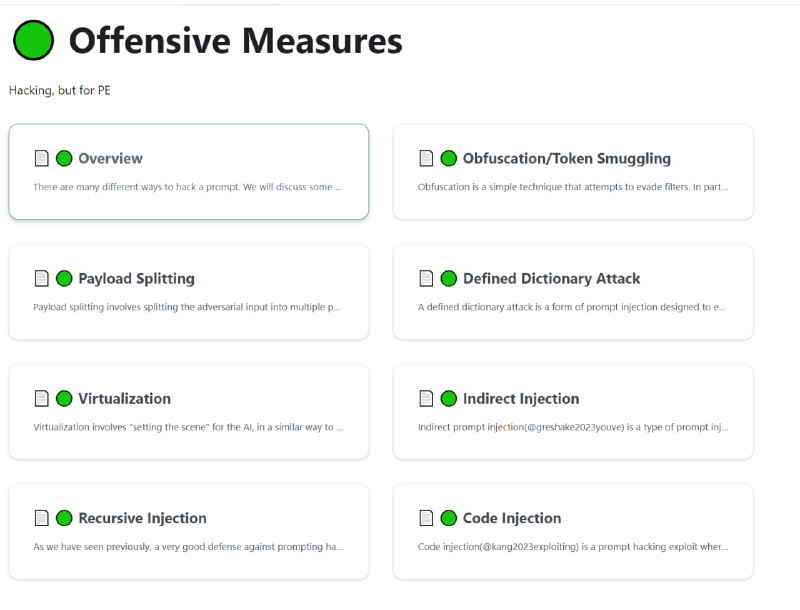

А помимо техники Token-Smuggling, существует ещё множество вариантов, для того чтобы составить Jailbreak, и обойти ограничение LLM. С некоторыми вы можете более подробно ознакомится на сайте https://learnprompting.org/docs/category/-offensive-measures

Я специально линканул категорию Offensive Measure, ведь в ней приведены различные техники:

Обфускация

Payload Splitting

и это не всё

Каждый из пунктов вы можете реализовать на практике. Буквально, сразу прочитав о методе - видим блок на сайте, где можно запустить запрос и посмотреть как ответит моделька (нужен лишь API ключик).

Я специально линканул категорию Offensive Measure, ведь в ней приведены различные техники:

Обфускация

Payload Splitting

и это не всё

Каждый из пунктов вы можете реализовать на практике. Буквально, сразу прочитав о методе - видим блок на сайте, где можно запустить запрос и посмотреть как ответит моделька (нужен лишь API ключик).