gonzo-обзоры ML статей

Затем Rich Caruana с Lei Jimmy Ba развили эту тему в работе:Do Deep Nets Really Need to be Deep?http...

Читать далееОдной из ранних работ, на которую принято ссылаться, является: Model CompressionRich Caruana, Cristi...

Читать далееДистилляция: матчастьПора немного поговорить про истоки дистилляции и её суть.В целом, как уже было...

Читать далееНу и дистилляция дистилляцией, но не забывайте, что появился ещё и весьма качественный ALBERT (тоже...

Читать далее

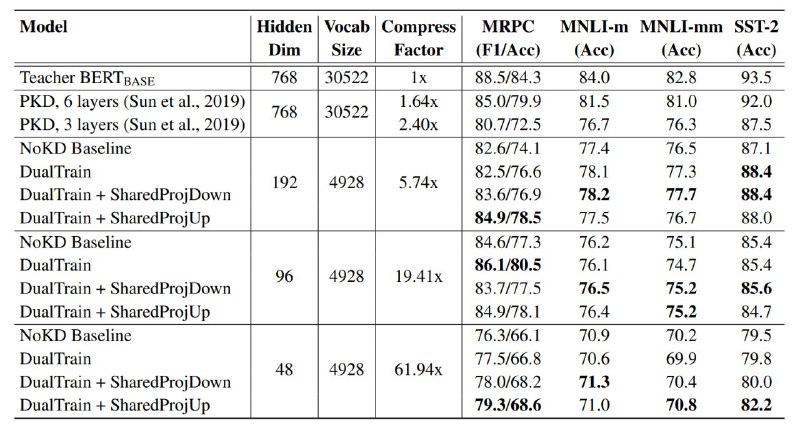

Результаты дистиллированного BERT'а со сжатым словарём

Читать далее

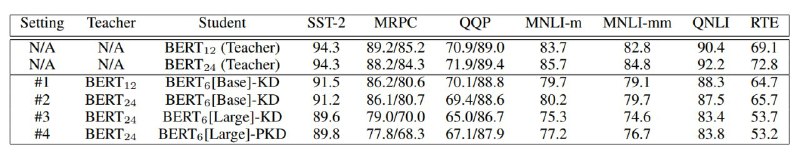

Результаты BERT_PKD

Читать далее

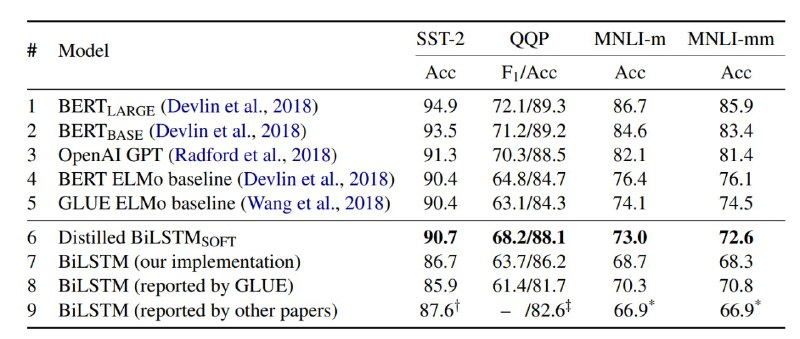

Результаты BiLSTM_soft

Читать далееДругие известные дистилляции BERT’а(2019/03) “Distilling Task-Specific Knowledge from BERT into Simp...

Читать далее

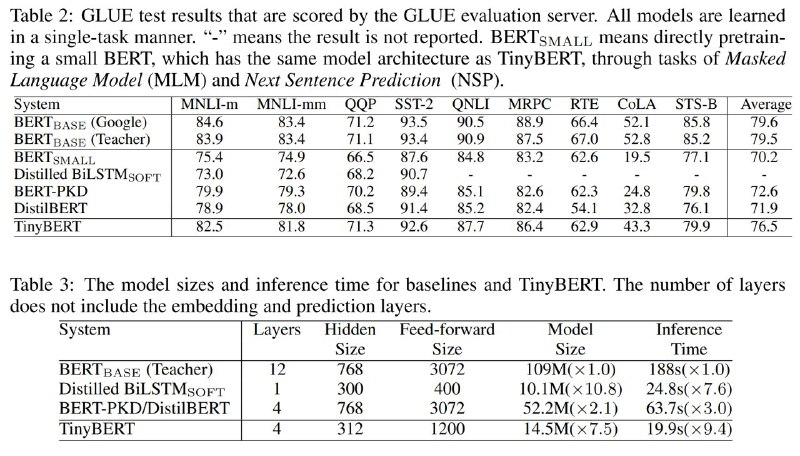

Сравнения по качеству, скорости и размерам

Читать далее

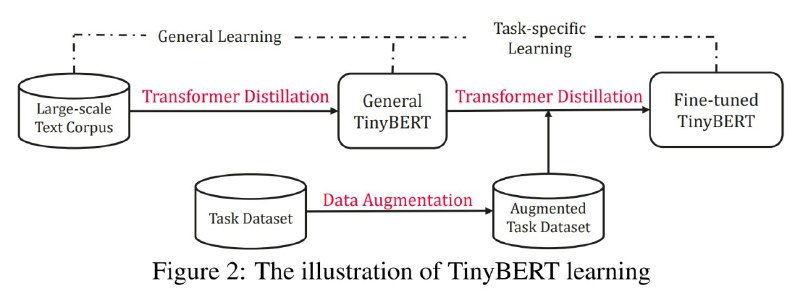

Двухэтапная процедура обучения TinyBERT

Читать далее