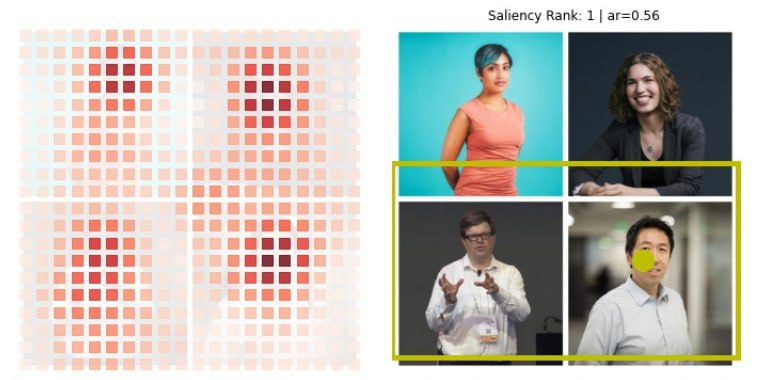

🖼 Инженеры Twitter протестировали на предвзятость алгоритм кадрирования фотографий для предварительного показа в ленте, который с помощью ИИ определяет наиболее интересные сцены в кадре.

Они проанализировали 10 000 обрезанных изображений и выяснили, что алгоритм предпочитал выделять белых женщин перед темнокожими в 7% случаев, и белых мужчин перед темнокожими в 2% случаев.

Исследователи также проверили систему на предмет предвзятости по половому признаку. Оказалось, что она отдавала предпочтение женщинам в 8% случаев и фокусировала внимание на лице, а не на других частях тела.

👍 В Twitter пришли к выводу, что алгоритм оказался непредвзятым, однако он все еще может быть оскорбительным. В компании решили отказаться от него в пользу показа полноразмерных изображений.

#Twitter

Они проанализировали 10 000 обрезанных изображений и выяснили, что алгоритм предпочитал выделять белых женщин перед темнокожими в 7% случаев, и белых мужчин перед темнокожими в 2% случаев.

Исследователи также проверили систему на предмет предвзятости по половому признаку. Оказалось, что она отдавала предпочтение женщинам в 8% случаев и фокусировала внимание на лице, а не на других частях тела.

👍 В Twitter пришли к выводу, что алгоритм оказался непредвзятым, однако он все еще может быть оскорбительным. В компании решили отказаться от него в пользу показа полноразмерных изображений.