ИИ не врет, а галлюцинирует 🤪

На этой неделе авторитетный английский словарь Cambridge Dictionary выбрал словом года «галлюцинировать» (hallucinate) — в привязке к искусственному интеллекту. Так в английском называют ситуации, когда нейросети дают ложную информацию.

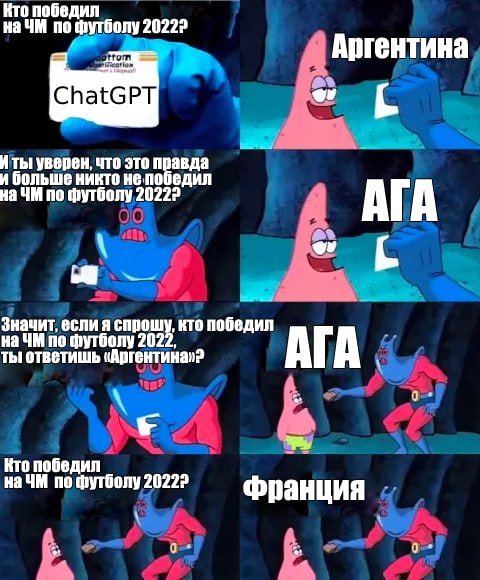

Галлюцинировать может и ChatGPT, таких примеров много. Это не намеренная ложь — у нейросетей нет таких задач. А есть задача генерировать текст. И когда у нейросетки нет достаточных данных, она создает случайный текст (вот вики-статья про эти галлюцинации).

Поэтому если работаете с важными фактами, лучше перепроверяйте текст. Как вариант, прогоняйте через другую нейросетку.

На этой неделе авторитетный английский словарь Cambridge Dictionary выбрал словом года «галлюцинировать» (hallucinate) — в привязке к искусственному интеллекту. Так в английском называют ситуации, когда нейросети дают ложную информацию.

Галлюцинировать может и ChatGPT, таких примеров много. Это не намеренная ложь — у нейросетей нет таких задач. А есть задача генерировать текст. И когда у нейросетки нет достаточных данных, она создает случайный текст (вот вики-статья про эти галлюцинации).

Поэтому если работаете с важными фактами, лучше перепроверяйте текст. Как вариант, прогоняйте через другую нейросетку.