⚡️ Замерили LLaMA и Сайгу на русском MMLU

Saiga это семейство моделей, обученных в режиме LLaMA + LoRA (основная модель заморожена, тюнится только адаптеры) на нескольких чатбот и инструктивных сетах:

https://github.com/IlyaGusev/rulm

MMLU это мульти-таск (57 разнообразных тематик/тасок, тестовых семплов ~14к) бенчмарк, где нужно для вопроса выбрать один из четырёх ответов (рандом даёт 0.25 качество), вопросы сложные, часто требуют доменных знаний (качество неэкспертных ответов людей 0.35):

https://arxiv.org/abs/2009.03300

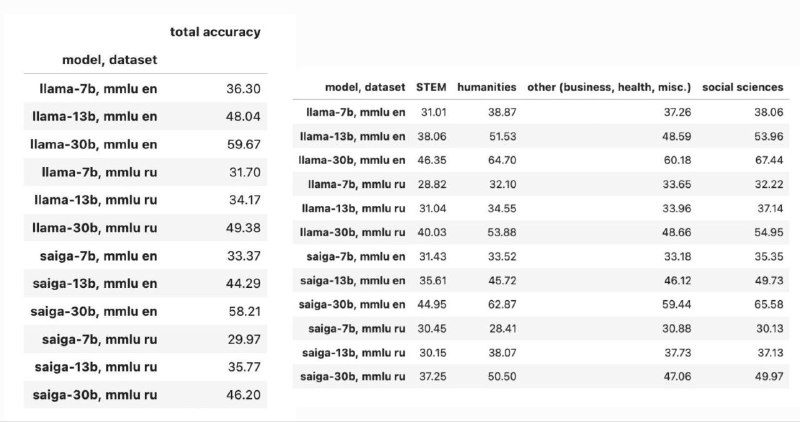

Мы перевели MMLU с помощью Yandex.Translate API с английского языка на русский, и замерили на исходном и переведённом сете модели Сайги доступные на HF. В сетапе few-shot k-5, выбирая ответ по вероятностям логитов вариантов A, B, C, D. Для Сайги готовили промпты в инструктивном формате.

LLaMA и Сайга показали хорошие результаты на русском MMLU. Хотя LLaMA видела очень мало русского на претрейне (меньше 1%), что удивляет.

Saiga это семейство моделей, обученных в режиме LLaMA + LoRA (основная модель заморожена, тюнится только адаптеры) на нескольких чатбот и инструктивных сетах:

https://github.com/IlyaGusev/rulm

MMLU это мульти-таск (57 разнообразных тематик/тасок, тестовых семплов ~14к) бенчмарк, где нужно для вопроса выбрать один из четырёх ответов (рандом даёт 0.25 качество), вопросы сложные, часто требуют доменных знаний (качество неэкспертных ответов людей 0.35):

https://arxiv.org/abs/2009.03300

Мы перевели MMLU с помощью Yandex.Translate API с английского языка на русский, и замерили на исходном и переведённом сете модели Сайги доступные на HF. В сетапе few-shot k-5, выбирая ответ по вероятностям логитов вариантов A, B, C, D. Для Сайги готовили промпты в инструктивном формате.

LLaMA и Сайга показали хорошие результаты на русском MMLU. Хотя LLaMA видела очень мало русского на претрейне (меньше 1%), что удивляет.