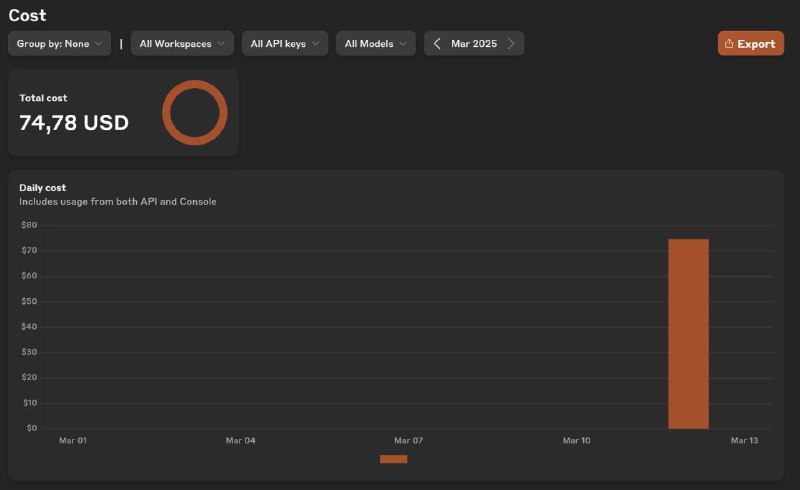

📹 На видео – загадочный процесс анализа, который идёт уже вторые сутки без остановки! API Sonnet 3.7 уже «съел» $74, и это только начало... 🧐

Что же я такое задумал?

🔍 Я решил масштабно проверить свои навыки промтинга, изучив сотни научных исследований по LLM. Их сейчас огромное количество, и в каждом скрыты практические фишки. Например, в прошлом году я узнал классный лайфхак: если на картинке что-то выделено стрелкой, GPT можно прямо указать «Посмотри сюда!» – и нейросеть поймёт, куда смотреть. И подобных нюансов сотни, вручную их изучить просто нереально! 🚀

📂 Сейчас у меня уже собрано 18 ГБ научных PDF (и база растет каждую минуту!), все они посвящены промтингу и LLM. Собираю исследования с помощью парсера, который написал GPT-o3-mini-high, ведь я до сих пор не программист и не собираюсь им становиться. Просто объясняю нейросети, что хочу получить 🤖.

После этого другой скрипт превращает PDF в текст и отправляет на «кастинг»: Gemini Flash 2.0 (через Openrouter) быстро фильтрует полезные исследования, а уже Sonnet 3.7 идеально делает саммари и выдаёт по 5 практических способов применения из каждой статьи 📑.

🔑 Большинство находок, конечно, мусор, но попадаются настоящие алмазы 💎 Например, подтвердилось, что чем длиннее чат с нейросетью, тем больше она забывает исходные детали. Если вначале сообщить «у меня аллергия на арахис», то через 300 сообщений GPT спокойно порекомендует ресторан с арахисовой пастой 🥜🤦🏻♂️. Решение оказалось простым: нейросети надо напоминать! «Предложи ресторан, но помни про мои предпочтения, о которых я говорил выше». Этот простой трюк я стал активно использовать при написании скриптов и резко сократил число ошибок. 🙌

🎬 Скорее всего, я запишу видео с лучшими и максимально полезными фишками из исследований. Пока обработаны только январь, февраль и 10 дней марта 2025 года — уже отобрал 900 статей из 4000. 📊

Очень приятно видеть, что к некоторым выводам я пришёл интуитивно, а учёные подтвердили их экспериментально! 😎

🔥 Ждите продолжения — впереди много инсайтов!

Что же я такое задумал?

🔍 Я решил масштабно проверить свои навыки промтинга, изучив сотни научных исследований по LLM. Их сейчас огромное количество, и в каждом скрыты практические фишки. Например, в прошлом году я узнал классный лайфхак: если на картинке что-то выделено стрелкой, GPT можно прямо указать «Посмотри сюда!» – и нейросеть поймёт, куда смотреть. И подобных нюансов сотни, вручную их изучить просто нереально! 🚀

📂 Сейчас у меня уже собрано 18 ГБ научных PDF (и база растет каждую минуту!), все они посвящены промтингу и LLM. Собираю исследования с помощью парсера, который написал GPT-o3-mini-high, ведь я до сих пор не программист и не собираюсь им становиться. Просто объясняю нейросети, что хочу получить 🤖.

После этого другой скрипт превращает PDF в текст и отправляет на «кастинг»: Gemini Flash 2.0 (через Openrouter) быстро фильтрует полезные исследования, а уже Sonnet 3.7 идеально делает саммари и выдаёт по 5 практических способов применения из каждой статьи 📑.

🔑 Большинство находок, конечно, мусор, но попадаются настоящие алмазы 💎 Например, подтвердилось, что чем длиннее чат с нейросетью, тем больше она забывает исходные детали. Если вначале сообщить «у меня аллергия на арахис», то через 300 сообщений GPT спокойно порекомендует ресторан с арахисовой пастой 🥜🤦🏻♂️. Решение оказалось простым: нейросети надо напоминать! «Предложи ресторан, но помни про мои предпочтения, о которых я говорил выше». Этот простой трюк я стал активно использовать при написании скриптов и резко сократил число ошибок. 🙌

🎬 Скорее всего, я запишу видео с лучшими и максимально полезными фишками из исследований. Пока обработаны только январь, февраль и 10 дней марта 2025 года — уже отобрал 900 статей из 4000. 📊

Очень приятно видеть, что к некоторым выводам я пришёл интуитивно, а учёные подтвердили их экспериментально! 😎

🔥 Ждите продолжения — впереди много инсайтов!