ShiftViT: An Extremely Simple Alternative to Attention Mechanism

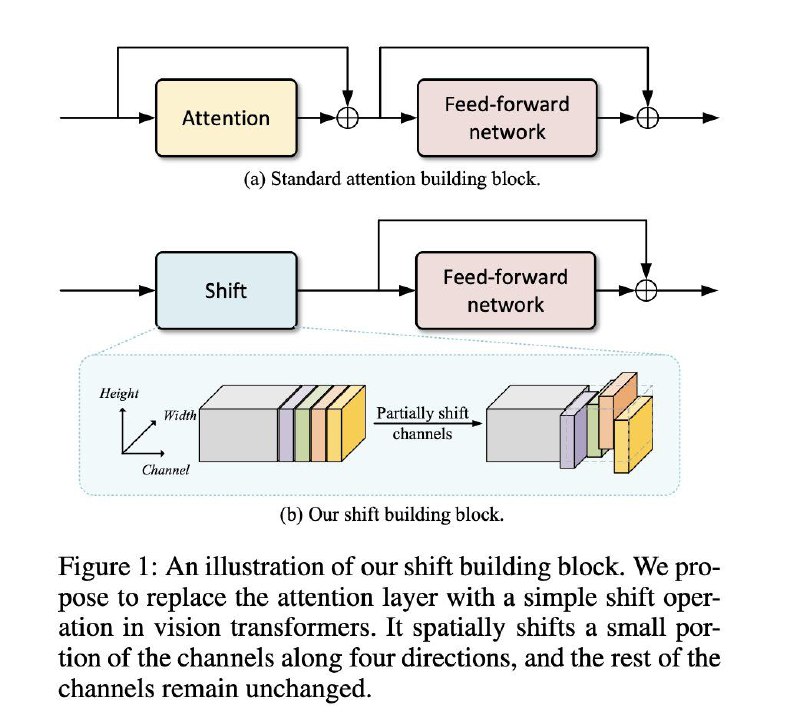

Мелкософт говорит, что селф-атеншен больше не нужен в задачах зрения. Предлагают вместо него просто каналы случайно подвигать в плоскости картинки.

Судя по всему, это должно работать быстрее. По результатам точность на Imagenet почти как у трансформеров, чуть-чуть ниже.

Статья | Код

Мелкософт говорит, что селф-атеншен больше не нужен в задачах зрения. Предлагают вместо него просто каналы случайно подвигать в плоскости картинки.

Судя по всему, это должно работать быстрее. По результатам точность на Imagenet почти как у трансформеров, чуть-чуть ниже.

Статья | Код