Новая опенсорсная модель от Databricks работает лучше Llama 2, Grok и Mixtral

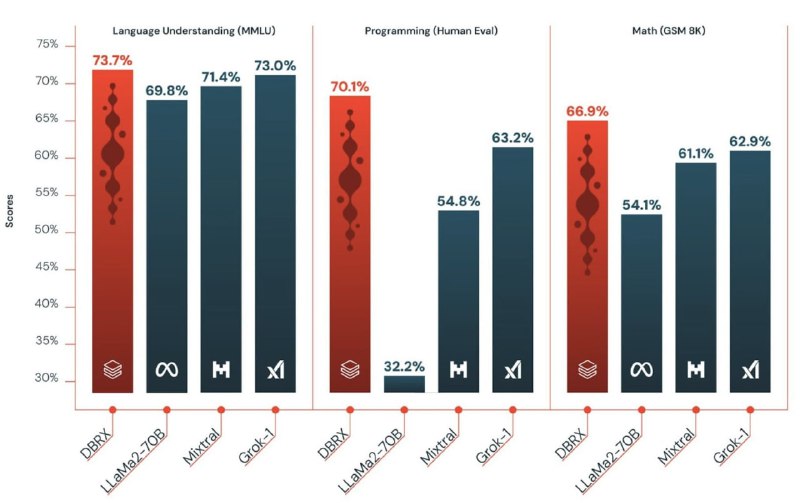

Модель DBRX превзошла конкурентов с открытым исходным кодом в понимании языка, математике и программировании. Русский язык модель тоже понимает, но отвечать на нем отказывается.

DBRX построена на архитектуре Mixture of Experts, имеет 132 миллиарда параметров и требует для работы не менее 320 гигабайт видеопамяти.

@AiMedium

Модель DBRX превзошла конкурентов с открытым исходным кодом в понимании языка, математике и программировании. Русский язык модель тоже понимает, но отвечать на нем отказывается.

DBRX построена на архитектуре Mixture of Experts, имеет 132 миллиарда параметров и требует для работы не менее 320 гигабайт видеопамяти.

@AiMedium